Buenos Aires, 03 agosto de 2023.

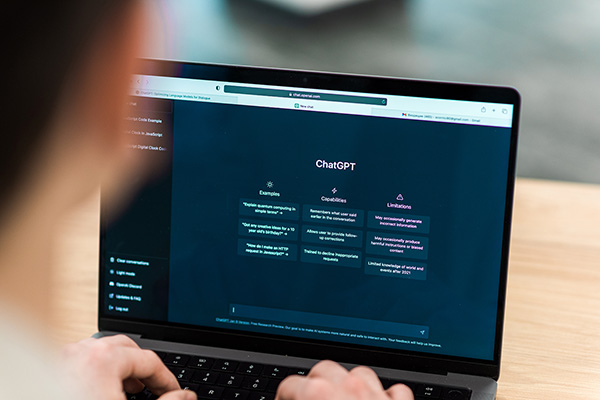

GPT4, ChatGPT, Bard, Bing y tantos otros que surgen todos los días son los nuevos interlocutores que se nos presentan como asistentes en tareas cotidianas, profesionales y académicas. El Departamento de Innovación Educativa de la Universidad CAECE comenzó a experimentar con estos modelos de lenguaje desde su surgimiento a fines de noviembre del 2022. Junto a los equipos docentes, han realizado talleres de sensibilización y han ofrecido webinars abiertos a la comunidad. Gracias a estas experiencias comparten algunos aprendizajes sobre cómo sacar el mayor beneficio de dichas herramientas.

Estos nuevos interlocutores son formas de Inteligencia Artificial generativa, modelos de lenguaje natural que nos permiten interactuar con computadoras de forma más natural y conversacional, tal como lo define UNESCO en su última guía de uso de inteligencia artificial en la educación superior. A partir de su uso podemos obtener productos en forma de videos, imágenes, audios, códigos y otros. Sin embargo, el de mayor impacto en educación es sin duda, la producción de textos verosímiles y de diálogos en lenguaje natural, en múltiples idiomas.

Como con todo lenguaje, es imprescindible conocer sus características culturales para obtener conversaciones con resultados productivos, entendiendo las limitaciones y potencialidades de nuestro interlocutor, en este caso, un no-humano.

Nora Lizenberg, Directora de la Especialización en Innovación Tecnológico Educativa en la Universidad CAECE asegura que “para sostener diálogos productivos se necesita informarle al chat o agente acerca de aquellos elementos que para los humanos se infieren rápidamente, pero que los no-humanos desconocen. Entre ellos podemos mencionar el contexto del diálogo o del producto que necesitamos que creen, el propósito, el registro discursivo, la estructura del texto o su extensión. Es recomendable también brindar ejemplos, extremar la precisión y claridad de lo que solicitamos y realizar ciclos de re-preguntas y construcción incremental”. Para la Directora, cuanto más podamos brindarle detalles y especificaciones, será mejor el resultado.

Asimismo, es necesario tener presente en el trabajo con estos no-humanos que sólo es seguro trabajar con ellos cuando se pueda chequear la veracidad y precisión de los contenidos ya sea desde la experiencia personal o a partir de otras fuentes confiables, y cuando no haya compromiso de derecho, seguridad o ética de los humanos.

Esto implica el desarrollo de habilidades y competencias complementarias, no sólo para quienes se dediquen al prompt engineering , sino también para todas las actividades atravesadas por estas tecnologías. “En el caso de la gestión de instituciones educativas, la docencia o los chief learning officers , estas habilidades y competencias ya son imprescindibles. Por ejemplo, en la Universidad CAECE todas las asignaturas de la nueva Especialización en Innovación Tecnológico-educativa están atravesadas por el análisis y el uso de estas herramientas” comentó Nora Lizenberg.

Si bien GPT4, y similares, son las herramientas recientes de inteligencia artificial de mayor impacto, no son las únicas que están cambiando la gestión, la enseñanza y el aprendizaje en educación. Tal es el caso de los bots o agentes inteligentes que permiten resolver las dudas más comunes o brindar orientación a los estudiantes y docentes. O incluso las herramientas de analítica de datos potenciadas con inteligencia artificial permiten realizar seguimiento de todas las actividades de la comunidad educativa y con esos datos realizar predicciones a tiempo para detectar posibles dificultades o deserciones, y automatizar acciones para prevenirlas, entre muchas otras.

Claro que no todas son ventajas, y tanto la comunidad académica como la sociedad en su conjunto enfrentan desafíos inherentes a estos game changers : el trabajo sobre los valores éticos, rediseñar las estrategias de evaluación para centrarse en los procesos como garantes de los aprendizajes, evitar los sesgos de las redes que se reproducen en las respuestas de los no-humanos, o el sesgo confirmatorio por obtener respuestas que coinciden con los supuestos de quien usa la herramienta. También contemplar las limitaciones aún existentes para realizar inferencias lógicas, y superar el efecto alucinatorio de creer que los textos son verídicos sólo por estar bien estructurados, o inclusive, la fantasía de estar dialogando con un ente con sentido común o sentimientos, sólo por mantener un diálogo que replica expresiones empáticas humanas.

“Algunas instituciones eligen resistir ante estos cambios desde la prohibición o la preservación de las formas tradicionales para sus actividades. Otras, eligen adaptarse, aprender y generar nuevo conocimiento. No hay recetas a aplicar. El desafío está planteado y está en nuestras manos como instituciones el aceptarlo”, concluye Lizenberg.

Chat GPT: ¿Cómo dialogar con no-humanos?

por: Nora Lizenberg